tutoriel

Installer nagios sur Fedora 11 depuis les sources

On considère que le serveur tourne, que apache est déjà installé et que le port 80 est ouvert, http://votre_serveur affiche une page web. Je pars sur une Fedora 11, car c’est un serveur que j’ai disponible et son rôle actuel me permet d’y ajouter Nagios pour une tâche de monitoring.

On considère que le serveur tourne, que apache est déjà installé et que le port 80 est ouvert, http://votre_serveur affiche une page web. Je pars sur une Fedora 11, car c’est un serveur que j’ai disponible et son rôle actuel me permet d’y ajouter Nagios pour une tâche de monitoring.

Je suis root sur le serveur, connecté en SSH.

1 – télécharger et décompresser les sources

[bash]wget http://prdownloads.sourceforge.net/sourceforge/nagios/nagios-3.2.3.tar.gz

tar xvzf nagios-3.2.3.tar.gz

cd nagios-3.2.3[/bash]

2 – ajouter le user nagios sur le serveur

[bash]adduser nagios

groupadd nagios[/bash]

3 – installer les dépendances

[bash]yum install gd gd-devel mod_perl jpeg-devel rrdtools-devel rrd rrdtool-devel fping net-snmp-perl perl-Net-ARP openldap-devel mysql-devel gnutls-devel radiusclient-ng-devel[/bash]

4 – Configurer et compiler Nagios

[bash]./configure –with-nagios-user=nagios –with-nagios-group=nagios

make all[/bash]

Le résultat doit afficher :

[bash]If the main program and CGIs compiled without any errors, you

can continue with installing Nagios as follows (type ‘make’

without any arguments for a list of all possible options):

make install

– This installs the main program, CGIs, and HTML files

make install-init

– This installs the init script in /etc/rc.d/init.d

make install-commandmode

– This installs and configures permissions on the

directory for holding the external command file

make install-config

– This installs *SAMPLE* config files in /usr/local/nagios/etc

You’ll have to modify these sample files before you can

use Nagios. Read the HTML documentation for more info

on doing this. Pay particular attention to the docs on

object configuration files, as they determine what/how

things get monitored!

make install-webconf

– This installs the Apache config file for the Nagios

web interface

*** Support Notes *******************************************

If you have questions about configuring or running Nagios,

please make sure that you:

– Look at the sample config files

– Read the HTML documentation

– Read the FAQs online at http://www.nagios.org/faqs

before you post a question to one of the mailing lists.

Also make sure to include pertinent information that could

help others help you. This might include:

– What version of Nagios you are using

– What version of the plugins you are using

– Relevant snippets from your config files

– Relevant error messages from the Nagios log file

For more information on obtaining support for Nagios, visit:

http://www.nagios.org/support/

*************************************************************

Enjoy.[/bash]

5 – Installer chaque élément en détail :

[bash]make install

make install-init

make install-commandmode

make install-config

make install-webconf

make install-html

make install-cgis[/bash]

Configurer le mot de passe pour l’accès à l’interface :

[bash]htpasswd -c /usr/local/nagios/etc/htpasswd.users nagiosadmin[/bash]

(Saisir le mot de passe de votre choix pour l’utilisateur nagiosadmin)

Note : s’assurer que le dossier /usr/local/nagios/sbin existe et contient bien les fichier .cgi

Note 2 : S’assurer que le dossier /usr/local/nagios/share existe et contient bien les fichiers php et dossiers images etc.

6 – faire le test de la configuration de Nagios :

[bash]/usr/local/nagios/bin/nagios -v /usr/local/nagios/etc/nagios.cfg[/bash]

7 – Activer le lancement automatique des services au boot

[bash]chkconfig –add nagios; chkconfig nagios[/bash]

(vérifier que ça se lance bien au démarrage).

8 – Téléchargement, configuration et installation des plugins

[bash]cd ..

wget http://prdownloads.sourceforge.net/sourceforge/nagiosplug/nagios-plugins-1.4.15.tar.gz

tar xvzf nagios-plugins-1.4.15.tar.gz

cd nagios-plugins-1.4.15

./configure –with-nagios-user=nagios –with-nagios-group=nagios

make

make install[/bash]

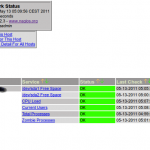

9 – Lancer Nagios et relancer apache et se connecter sur http://votre_serveur/nagios

[bash]/etc/rc.d/init.d/nagios restart

/etc/rc.d/init.d/httpd restat[/bash]

#########################

# CONFIGURATION DU CLIENT NRPE #

#########################

10 – Pour monitorer d’autres machines on passera par NRPE (SNMP est aussi possible, mais je ne le traite pas ici)

Les autres machines sont considérées comme « clientes », sur chacune d’elle on doit installer Nagios-plugins et NRPE.

Les plugins fournissent les scripts permettant de monitorer les services, et NRPE permet de remonter l’information au serveur Nagios précédemment installée en exécutant ces scripts.

10.1 – Création de l’utilisateur et du groupe nagios sur la machine cliente qui va être équipée de NRPE

[bash]adduser nagios

groupadd nagios[/bash]

10.2 Installation des dépendances, comme pour le serveur (en root également, ici aussi une fedora):

[bash]yum install gd gd-devel mod_perl jpeg-devel rrdtools-devel rrd rrdtool-devel fping net-snmp-perl perl-Net-ARP openldap-devel mysql-devel gnutls-devel radiusclient-ng-devel net-snmp-devel[/bash]

10.3 – Téléchargement et installation des plugins nagios depuis http://www.nagios.org/download/plugins

[bash]wget http://prdownloads.sourceforge.net/sourceforge/nagiosplug/nagios-plugins-1.4.15.tar.gz

tar xvzf nagios-plugins-1.4.15.tar.gz

cd nagios-plugins-1.4.15

./configure –with-nagios-user=nagios –with-nagios-group=nagios

make

make install[/bash]

Les plugins doivent être installés dans /usr/local/nagios/libexec/

On attribue les bon droits :

[bash]chown nagios:nagios /usr/local/nagios

chown -R nagios:nagios /usr/local/nagios/libexec[/bash]

10.4 Téléchargement et installation de NRPE depuis http://exchange.nagios.org/directory/Addons/Monitoring-Agents/NRPE-%252D-Nagios-Remote-Plugin-Executor/details

Pour les détails, l’archive contient un dossier docs avec un document PDF très bien fait :)

[bash]wget http://prdownloads.sourceforge.net/sourceforge/nagios/nrpe-2.12.tar.gz

tar xvzf nrpe-2.12.tar.gz

cd nrpe-2.12

./configure

make all

make install-plugin

make install-daemon

make install-daemon-config

cp init-script /etc/rc.d/init.d/nrpe

chmod 755 /etc/rc.d/init.d/nrpe

chkconfig –add nrpe;chkconfig nrpe[/bash]

(vérifier que le lancement soit bien actif)

On ajoute le service dans /etc/service en ajoutant au fichier dans l’ordre des ports la ligne suivante :

[bash]nrpe 5666/tcp # NRPE remote nagios[/bash]

On teste l’installation :

[bash]/usr/local/nagios/libexec/check_nrpe -H localhost[/bash]

ça doit renvoyer la version de NRPE :)

Ouvrir le firewall pour permettre au demon d’être joignable depuis une autre machine :

[bash]iptables -I RH-Firewall-1-INPUT -p tcp -m tcp –dport 5666 -j ACCEPT[/bash]

ou (selon la configuration de votre iptables)

[bash]iptables -I INPUT -p tcp -m tcp –dport 5666 -j ACCEPT[/bash]

On sauve la règle :

[bash]cp /etc/sysconfig/iptables /etc/sysconfig/iptables-avant-nrpe;iptables-save > /etc/sysconfig/iptables[/bash]

On édite la configuratoin de NRPE sur le client toujours dans le fichier /usr/local/nagios/etc/nrpe.cfg.

Le fichier est plutôt bien documenté, je suggère de le lire en entier. La ligne qui nous intéresse est :

[bash]allowed_hosts=127.0.0.1[/bash]

à laquelle il faut ajouter « ,ip_du_serveur_nagios » pour l’autoriser à communiquer avec NRPE sur cette machine.

Par défaut on va utiliser les plugins codés en dur, en bas du fichier vous pouvez en ajouter sur le modèle des plugins utilisés dans nagios habituellement (corriger le disque hda1 en sda1, ajouter une commande par copier/coller pour sda2 etc.).

Puis on relance NRPE.

[bash]/etc/rc.d/init.d/nrpe restart[/bash]

10.5 Configuration de NRPE sur la machine Nagios

On télécharge l’archive sur la machine où nous avons installé nagios :

[bash]wget http://prdownloads.sourceforge.net/sourceforge/nagios/nrpe-2.12.tar.gz

tar xvzf nrpe-2.12.tar.gz

cd nrpe-2.12

./configure

make all

make install-plugin[/bash]

On teste l’installation en local (attention à l’ouverture de port dans le firewall au besoin pour ce test)

[bash]/usr/local/nagios/libexec/check_nrpe -H localhost[/bash]

et surtout on teste l’hote distant :

[bash]/usr/local/nagios/libexec/check_nrpe -H votre_hote_distant -t 100[/bash]

Vous devez voir la version de NRPE installée en retour. En cas d’erreur, regarder les syslog sur l’autre machine et vérifier le firewall !

On peut ensuite tester les commandes spécifiques installées par défaut depuis la machine nagios sur la machine monitorée :

[bash]/usr/local/nagios/libexec/check_nrpe -H votre_hote_distant -c check_users

/usr/local/nagios/libexec/check_nrpe -H votre_hote_distant -c check_load

/usr/local/nagios/libexec/check_nrpe -H votre_hote_distant -c check_sda1

/usr/local/nagios/libexec/check_nrpe -H votre_hote_distant -c check_total_procs

/usr/local/nagios/libexec/check_nrpe -H votre_hote_distant -c check_zombie_procs[/bash]

Ceci soit renvoyer les valeurs de la machine distante.

10.6 Configuration de Nagios pour utiliser NRPE

Par défaut, l’installation de Nagios comporte une seule machine à monitorer configurée (localhost) dans un seul fichier de configuration.

Ceci est défini dans /usr/local/nagios/etc/nagios.cfg avec une ligne qui contient :

[bash]# Definitions for monitoring the local (Linux) host

cfg_file=/usr/local/nagios/etc/objects/localhost.cfg[/bash]

Un peu plus bas dans le fichier on peut définir suivant l’exemple un dossier qui sera parcouru par nagios à la recherche de tous les fichiers .cfg qui s’y trouvent, afin de pouvoir ajouter un fichier de configuration par hote.

On peut aussi définir un chemin par hote en dur comme indiqué pour la machine locale, libre choix !

On crée donc un dossier pour les machines dans lequel on placera toutes les configurations :

[bash]mkdir /usr/local/nagios/etc/machines

chown nagios:nagios /usr/local/nagios/etc/machines[/bash]

Puis on ajoute dans le fichier de configuration /usr/local/nagios/etc/nagios.cfg la ligne suivante :

[bash]cfg_dir=/usr/local/nagios/etc/machines[/bash]

Ainsi à chaque rechargement de nagios, tous les fichiers de configuration .cfg dans le dossier défini seront pris en compte.

On va maintenant ajouter la commande qui permet d’utiliser NRPE dans nagios.

Il faut ajouter ce qui suit dans le fichier /usr/local/nagios/etc/objects/commands.cfg :

[bash]#Commande utilisée pour interroger les hotes distants équipés de NRPE

define command{

command_name check_nrpe

command_line $USER1$/check_nrpe -H $HOSTADDRESS$ -c $ARG1$

}[/bash]

On apprend à Nagios la commande check_nrpe ! :D

On va ensuite créer un template (modèle) de machine type, ici un modèle de machine linux que nous souhaitons surveiller.

On va ajouter ce template dans le fichier /usr/local/nagios/etc/objects/templates.cfg sous les hosts templates existant (donc juste au dessus de « SERVICE TEMPLATES » :

[bash]# Defini un modèle d’hotes que l’on va utiliser pour nos machines distantes avec nrpe.

define host{

name linux-box-distant ; Name of this template

use generic-host ; Inherit default values

check_period 24×7

check_interval 5

retry_interval 1

max_check_attempts 10

check_command check-host-alive

notification_period 24×7

notification_interval 30

notification_options d,r

contact_groups admins

register 0 ; DONT REGISTER THIS – ITS A TEMPLATE

}[/bash]

(Voir les templates existant pour adapter les valeurs à vos besoins)

On va maintenant créer un fichier de configuration machine-distante1.cfg pour notre nouvel hote dans /usr/local/nagios/etc/machines/ que nous avons créé un peu avant :)

On va mettre dans ce fichier « machine la définition de la machine :

[bash]#Definition machine à surveiller

define host{

use linux-box-distant ; Inherit default values from a template

host_name machine-distante1 ; The name we’re giving to this server

alias Serveur archives 1 ; A longer name for the server

address 192.168.0.1 ; IP address of the server

}[/bash]

Dans ce même fichier machine-distante1.cfg on va ajouter les services que l’on souhaite surveiller.

On dispore des services définis dans le fichier nrpe.cfg sur le serveur distant que l’on souhaite surveiller (les command[check…) :

[bash]#Definition des services surveillés dans la machine :

#Surveillance CPU LOAD

define service{

use generic-service ;basé sur le template qui défini generic-service

host_name machine-distante1 ;le nom du serveur distant

service_description CPU Load

check_command check_nrpe!check_load

}

#Suveillance du nombre d’utilisateurs

define service{

use generic-service

host_name machine-distante1

service_description Current Users

check_command check_nrpe!check_users

}

#Espace libre sur sda1

define service{

use generic-service

host_name machine-distante1

service_description /dev/sda1 Free Space

check_command check_nrpe!check_sda1

}

#Nombre total de processus

define service{

use generic-service

host_name machine-distante1

service_description Total Processes

check_command check_nrpe!check_total_procs

}

#Processus Zombie

define service{

use generic-service

host_name machine-distante1

service_description Zombie Processes

check_command check_nrpe!check_zombie_procs

}[/bash]

Voilà pour la configuration du base, on comprend vite les possibilités avec ça, de personnaliser la configuration selon nos propres souhaits :D Même si cette version de base est déjà très intéressante.

Pour prendre en compte les modifications, il suffit de redémarrer nagios :

[bash]/etc/rc.d/init.d/nagios restart[/bash]

La machine ajoutée doit être présente dans l’interface web de Nagios sur la page « Hosts ».

Vous pouvez maintenant ajouter autant de fichiers .cfg que voulu par machine dans le dossier « machines » de votre serveur nagios, et redémarrer nagios pour prendre en compte chaque nouvelle machine (en ayant installé et configuré NRPE sur la machine concernée) !

Vous êtes maintenant capable de démarrer l’utilisation de la solution nagios de manière efficace :D Bien sur lire les commentaires dans les fichiers de configuration exemple pour en savoir plus sur les possibilités, notamment les alertes etc. :D !

Liens et références utilisées pour la réalisation de cet article :

http://blog.lolo.org/?p=11

http://www.it-sudparis.eu/s2ia/user/procacci/Doc/nagios/nagios.html#htoc15

http://michauko.org/blog/2010/01/06/nrpe-monitorer-des-linux-avec-nagios/

http://michauko.org/blog/2009/10/07/mise-en-place-de-nagios/

http://www.nagios.org/download/addons

http://www.nagios.org/download/

Et une référence immanquables, avec des sujets toujours bien traités et lisibles (contrairement à moi j’avoue :p ) :

http://blog.nicolargo.com/nagios-tutoriels-et-documentations

![]()

Installation de GFS pour utilisation avec volume DRBD sous Centos 5.5 ou redhat

Pour faire suite à la mise en place de DRBD dans mon post précédent (http://blog.inforeseau.com/2011/03/installation-drbd-sur-centos-5-5-ou-redhat), nous allons voir la mise en place de GFS, un système de fichier supportant les accès concurrentiels, et permettant ainsi à 2 systèmes (dans le cas présent) d’accéder à un support de stockage simultanément.

A réaliser sur les deux machines concernées (les machines qui partagent le volume DRBD et qui vont constituer notre cluster) :

Il nous faut tout dabord, CMAN (cluster manager) et le support GFS2 :

[bash]yum install gfs-utils gfs2-utils cman

yum groupinstall Clustering[/bash]

Pour configurer le fichier de configuration de base du cluster, j’ai utilisé l’interface graphique « system-config-cluster » pour avoir un modèle, mais on peut créer le fichier à la main directement et définir les éléments du cluster (Ce fichier permet de définir les éléments du cluster pour CMAN qui va gérer les verrous).

[bash]<?xml version="1.0" ?>

<cluster config_version="3" name="mon_cluster">

<fence_daemon post_fail_delay="1" post_join_delay="6"/>

<clusternodes>

<clusternode name="pcmsi" nodeid="1" votes="1">

<fence/>

</clusternode>

<clusternode name="pchp" nodeid="2" votes="1">

<fence/>

</clusternode>

</clusternodes>

<cman expected_votes="1" two_node="1"/>

<fencedevices/>

<rm>

<failoverdomains/>

<resources/>

</rm>

</cluster>[/bash]

(man cluster.conf ou man fenced pour plus d’infos sur les paramètres du fichier ci dessus, j’ai augmenté le post_fail_delay à 1 seconde qui est à 0 par défaut à cause de latence sur mon réseau d’expérimentation qui est loin d’être performant! Plus d’infos sur les paramètres notamment liés au quorum (système d’élection dans le cluster) : http://sourceware.org/cluster/wiki/FAQ/CMAN#cman_quorum).

A noter également, la possibilité de modifier le délai de coupure considéré comme étant une rupture de liaison, entrainant le blocage du service (fence = ejection du noeud qui ne répond pas, bloquant l’accès au système GFS avec seulement 2 noeuds dans le cluster) : http://sourceware.org/cluster/wiki/FAQ/CMAN#cman_deadnode_timer

On autorise le trafic dans le firewall entre les noeuds du cluster (attention ici en réseau protégé, limitez les connexions aux machines de confiance, idéalement sur un réseau dédié au cluster).

ATTENTION SI VOUS AVEZ DEJA UNE CONFIGURATION IPTABLES SAUVEZ LE FICHIER AVANT D’UTILISER CE SCRIPT (EN CAS DE DOUTE, PRÉFÉRER LA MÉTHODE MANUELLE EN AJOUTANT LES RÈGLES IPTABLES A LA MAIN COMME INDIQUÉ JUSTE APRÈS).

Avec Iptables, on va utiliser un petit script pour configurer iptables afin d’autoriser le trafic pour le cluster.

Le fichier qui va bien (source : http://www.open-sharedroot.org/faq/administrators-handbook/cluster-system-administration/ports-being-in-use-by-the-red-hat-cluster-software) :

[bash]#!/bin/bash

IPTABLES=/sbin/iptables

CLUSTER_INTERFACE=eth0

TCP_PORTS="41966 41967 41968 41969 50006 50008 50009 21064"

UPD_PORTS="50007 5405"

echo -n "Applying iptables rules"

for port in $TCP_PORTS; do

$IPTABLES -I INPUT -i $CLUSTER_INTERFACE -p tcp -m tcp –sport $port -j ACCEPT

$IPTABLES -I INPUT -i $CLUSTER_INTERFACE -p tcp -m tcp –dport $port -j ACCEPT

$IPTABLES -I OUTPUT -o $CLUSTER_INTERFACE -p tcp -m tcp –dport $port -j ACCEPT

$IPTABLES -I OUTPUT -o $CLUSTER_INTERFACE -p tcp -m tcp –sport $port -j ACCEPT

done

for port in $UPD_PORTS; do

$IPTABLES -I INPUT -i $CLUSTER_INTERFACE -p udp -m udp –sport $port -j ACCEPT

$IPTABLES -I INPUT -i $CLUSTER_INTERFACE -p udp -m udp –dport $port -j ACCEPT

$IPTABLES -I OUTPUT -o $CLUSTER_INTERFACE -p udp -m udp –dport $port -j ACCEPT

$IPTABLES -I OUTPUT -o $CLUSTER_INTERFACE -p udp -m udp –sport $port -j ACCEPT

done

echo "[OK]"

echo -n "Saving new rules"

(/etc/init.d/iptables save && \

echo "[OK]") || echo "[FAILED]"[/bash]

On l’exécute évidemment pour appliquer les règles qui permettent le trafic. Attention encore, cette configuration ne filtre rien, et considère que vous utilisez une carte réseau dédiée (la CLUSTER_INTERFACE eth0 ici) pour le cluster, sans interception de trafic possible, un câble réseau dédié en gros (pas utilisable sur un réseau ouvert).

Note : on peut sauver la configuration iptables de manière permanente comme suit (recommandé pour le relancement du cluster en cas de reboot) :

[bash]/sbin/iptables-save>/etc/sysconfig/iptables[/bash]

SI LE SCRIPT AU DESSUS VOUS POSE PROBLEME – METHODE MANUELLE (ce qui a été le cas sur une machine pour moi) :

Voici simplement les lignes à ajouter dans /etc/sysconfig/iptables avant les 2 lignes du bas (REJECT et COMMIT) pour permettre la communication du cluster, si vous utilisez ETH0 pour la communication du cluster :

[bash]-A RH-Firewall-1-INPUT -i eth0 -p udp -m udp –dport 5405 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p udp -m udp –sport 5405 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p udp -m udp –dport 50007 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p udp -m udp –sport 50007 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –dport 21064 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –sport 21064 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –dport 50009 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –sport 50009 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –dport 50008 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –sport 50008 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –dport 50006 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –sport 50006 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –dport 41969 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –sport 41969 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –dport 41968 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –sport 41968 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –dport 41967 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –sport 41967 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –dport 41966 -j ACCEPT

-A RH-Firewall-1-INPUT -i eth0 -p tcp -m tcp –sport 41966 -j ACCEPT[/bash]

Après avoir ajouté ces lignes, relancez iptables et c’est réglé.

Puis on active les services au démarrage :

[bash]chkconfig cman on

chkconfig gfs2 on[/bash]

On lance les services :

[bash]service cman start

service gfs2 start[/bash]

On crée le système de fichier gfs2 sur le volume géré par DRBD (uniquement sur la machine principale) :

[bash]mkfs.gfs2 -p lock_dlm -t mon_cluster:vbox /dev/drbd1 -j 2[/bash]

On passe les 2 machines en primary sur DRBD si ça n’est pas le cas (nécessaire pour le montage simultané des ressources):

[bash]drbdadm primary resource[/bash]

On monte le volume une fois créé sur les deux machines :

[bash]mkdir /mnt/drbd

mount -t gfs2 /dev/drbd1 /mnt/drbd[/bash]

Voilà, c’est opérationnel, les deux machines peuvent lire et écrire sur le volume /dev/drbd1 grâce à la gestion du verrou par le cluster.

Quelques références utilisées pour la réalisation de ce post :

http://www.redhat.com/gfs/

http://www.cyberciti.biz/faq/linux-cluster-suite-software/

http://securfox.wordpress.com/2009/08/11/how-to-setup-gfs/

http://sources.redhat.com/cluster/wiki/FAQ/CMAN#two_node

http://www.open-sharedroot.org/faq/administrators-handbook/cluster-system-administration/ports-being-in-use-by-the-red-hat-cluster-software

http://www.sourceware.org/cluster/wiki/DRBD_Cookbook

http://www.drbd.org/users-guide/ch-gfs.html

Ici un autre tuto complet et très clair avec Debian, GFS2 et DRBD :

http://gcharriere.com/blog/?p=73

et à lire un commentaire très pertinent sur la procédure qui s’applique également à mon post :

http://gcharriere.com/blog/?p=73#comment-15

Un article assez complet sur la haute disponibilité chez Redhat :

http://docs.redhat.com/docs/fr-FR/Red_Hat_Enterprise_Linux/5/html-single/Cluster_Suite_Overview/index.html#fig-intro-cluster-CSO

![]()

Installer ruby on rails sur fedora 11

|

|

|

Ceci est un cas d’école qui reproduit une situation rencontrée en prod. Comme toujours, à lire en entier avant de modifier votre système :)

Télécharger les sources ruby à la bonne version (1.8.7 mini pour le support de Rails) :

[bash]wget ftp://ftp.ruby-lang.org//pub/ruby/ruby-1.8.7-p334.tar.gz[/bash]

Décompresser :

[bash]tar xvzf ruby-1.8.7-p334.tar.gz[/bash]

Entrer dans le dossier :

[bash]cd ruby-1.8.7-p334[/bash]

Configurer :

[bash]./configure[/bash]

Compiler :

[bash]make[/bash]

tester :

[bash]make test[/bash]

installer :

[bash]make install[/bash]

Voilà, l’interpréteur RUBY est installé sur le système. On va maintenant installer « RubyGems », le gestionnaire de packages.

RubyGems est une plateforme gestionnaire de paquets pour Ruby (comme apt pour ubuntu ou yum pour fedora/centos/redhat).

Télécharger les sources à la dernière version :

[bash]wget http://production.cf.rubygems.org/rubygems/rubygems-1.6.0.tgz[/bash]

Décompresser :

[bash]tar xvzf rubygems-1.6.0.tgz[/bash]

Entrer dans le dossier :

[bash]cd rubygems-1.6.0[/bash]

On lance l’install en Ruby :

[bash]ruby setup.rb[/bash]

Gem est installé ! On continue et on install rails grâce à gem :

[bash]gem install rails –include-dependencies[/bash]

(si il y a une erreur sur la documentation de ri, on relance, si ça persiste on ignore, vous devez avoir le message « Successfully installed rails-3.0.5 »).

Rails est maintenant installé. On va s’occuper d’installer « Passenger », qui est le module apache permettant de publier les applications utilisant Rubyonrails (et de les interpréter par la même occasion!).

Nous allons utiliser gem tout juste installé pour paramétrer « passenger » :

[bash]gem install passenger[/bash]

Puis on allons installer le module apache « passenger » :

[bash]passenger-install-apache2-module[/bash]

Si il manque des éléments il suffit de suivre les instructions (j’ai fait un ctrl+c pour interrompre et installer les manquants, puis relancé) ! L’installateur vous guide et est extrêmement bien fait! Pour ma part j’ai du installer ces quelques packages manquants (ça peut être différent selon ce qui est présent ou non sur votre système) :

[bash]yum install gcc-c++ curl-devel zlib-devel httpd-devel apr-devel apr-util-devel[/bash]

Après ça, l’installateur m’indique de copier les lignes suivantes dans ma configuration apache :

[bash] LoadModule passenger_module /usr/local/lib/ruby/gems/1.8/gems/passenger-3.0.4/ext/apache2/mod_passenger.so

PassengerRoot /usr/local/lib/ruby/gems/1.8/gems/passenger-3.0.4

PassengerRuby /usr/local/bin/ruby

[/bash]

J’ai donc créé un fichier rubyonrails.conf dans /etc/httpd/conf.d/ contenant ces lignes, et relancé apache.

Pour finir l’installateur me donne un exemple de configuration pour déployer une application rubyonrails :

[bash]

——————————————–

Deploying a Ruby on Rails application: an example

Suppose you have a Rails application in /somewhere. Add a virtual host to your

Apache configuration file and set its DocumentRoot to /somewhere/public:

<VirtualHost *:80>

ServerName www.yourhost.com

DocumentRoot /somewhere/public # <– be sure to point to ‘public’!

<Directory /somewhere/public>

AllowOverride all # <– relax Apache security settings

Options -MultiViews # <– MultiViews must be turned off

</Directory>

</VirtualHost>

[/bash]

C’est clair et net, rien à dire, votre installation est terminée, vous pouvez maintenant déployer une application !

Évidemment vous l’aurez compris, j’avais déjà ici une installation de apache 2 fonctionnelle (LAMP pour être exact). Sur ce type d’installation vous pouvez vérifier la prise en charge du module « passenger » en créant une fichier php dans un site géré par votre serveur apache, contenant la commande phpinfo.

[bash]

<?php

phpinfo();

?>

[/bash]

En appelant la page php qui contient ce code, dans la rubrique « Loaded Modules » de « apache2handler » vous devriez trouver « mod_passenger ».

Sources :

http://www.ruby-lang.org/fr/

http://rubyonrails.org/download

http://rubygems.org/

http://yken.org/2008/10/18/ruby-rails-and-httpd-on-fedora-8/

http://www.modrails.com/

![]()

Links

Calendrier

| L | M | M | J | V | S | D |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

| 29 | 30 | 31 | ||||

Recherche

Derniers articles

Tresronours Twitter

Keywords cloud topic

Membre de la FSF

Liens qui vont bien

Mots clés vrac – keyword cloud

License du contenu – CC By NC SA

Archives

- Getting voLTE on your Android with Fizz and others

- Defining the scope of an ISMS within ISO 27001

- Resumed posting and expanding on X

- Linkedin Access to your account has been restricted – Final debrief and resilience plan

- I’m thankful for the support I get in rough time

- Cyber security news of the day – 2024 May 31

- Alexandre Blanc Cyber Kicked out from Linkedin

- You’ll most likely find me on LinkedIn

- The Russian roulette landing page !

- RTSP, Debian, VLC, not playing, IP Camera

- 5G network hosted in the cloud, no internet, no phone ! So smart ! And I ended on TV, This week in cyber

- They lock the door for privacy… but they keep a copy of the key, and couple of backdoors

- Worst is yet to come, but they all warned you

- Migrating an old WordPress and handling character set, UTF8, latin1, latin1_swedish_ci

- From a broken TLS CA, to Facebook, to FIN12 hit and run

- Yes we can fix this mess, but do we want to ? That’s another story

- Criminals are still dominating the game, why are we doing so wrong, and what can we learn in this tech ocean ?

- Riding cloud can be tricky, don’t fall from it, in the weekly cyber !

- The threat landscape is very dynamic – Cyber news this week

- Cybersecurity is not obvious even for this newsletter !

- Install Slack desktop app on Kali rolling fixing libappindicator3-1 missing dependency

- How to delete all resources in azure to avoid charges after trial on your forced credit card registration

- Proxmox – ZFS – Dead drive on active VM, recover from replicated disk

- Restrict access to proxmox web admin interface

- Migrate your ESXI VMs to proxmox ZFS

- Install your VPN server with pi-hole on OVH VPS in 30 min

- Using raspberry pi 3 as wifi bridge and repeater and firewall

- Raspberry 3 – create a wifi repeater with USB wifi dongle

- raspberry 3 – routeur pare feu point d’acces wifi avec filtrage pub et tracking – router firewall access point with ads and tracking filtering

- Dell XPS 13 touchpad – corriger la sensibilité

- Utiliser Zazeen set top box depuis une connexion videotron

- Fermeture de mon compte facebook – la dernière goutte

- Choisir un kernel par defaut au demarrage de Centos 7.2 – configuration grub2

- Openvpn access server 2.0.25 et android

- Régler la luminosité du laptop par ligne de commande

- chromium outlook web app version complete sous linux

- Nexus 7 2012 – android 5 lollipop solution au probleme de lenteur

- HDD led sur Xubuntu – xfce

- xubuntu 14.04 verrouiller ecran de veille et desactiver mise en veille a la fermeture de l’ecran

- Authentification avec Radmin en utilisant Wine sur Gentoo

- Patcher bash sur une distribution plus supportee comme fedora 11

- Zimbra desktop sous xubuntu 14.04 64bit – fix

- xubuntu 12.10 probleme de son avec VLC – pulse audio – alsa – toshiba L855D – solution

- Evolution sous xubuntu 12.10 – bug affichage a la configuration – solution temporaire

- Booster son acces internet en changeant de DNS pour opendns

- Serveur DLNA sous ubuntu – minidlna

- sshfs sous windows – dokan sshfs

- xubuntu 11.10 Installer le plugin java pour firefox

- Installer Google Earth sur Xubuntu 11.10

- Installer nagios sur Fedora 11 depuis les sources